题目内容

(请给出正确答案)

题目内容

(请给出正确答案)

有关BP网络的说法,哪个是正确的()?

A.交叉熵也可以作为分类预测问题的损失函数

B.在使用梯度下降时,加上冲量项会减少训练的速度,但可能会增加陷入局部极小值的可能

C.与批量梯度下降法相比,使用小批量梯度下降法可以降低训练速度,但达到全局最优解可能需要更多的迭代次数

D.神经元的激活函数选择不影响神经网络的训练过程和最终性能

如搜索结果不匹配,请 联系老师 获取答案

如搜索结果不匹配,请 联系老师 获取答案

题目内容

(请给出正确答案)

题目内容

(请给出正确答案)

A.交叉熵也可以作为分类预测问题的损失函数

B.在使用梯度下降时,加上冲量项会减少训练的速度,但可能会增加陷入局部极小值的可能

C.与批量梯度下降法相比,使用小批量梯度下降法可以降低训练速度,但达到全局最优解可能需要更多的迭代次数

D.神经元的激活函数选择不影响神经网络的训练过程和最终性能

如搜索结果不匹配,请 联系老师 获取答案

如搜索结果不匹配,请 联系老师 获取答案

更多“有关BP网络的说法,哪个是正确的()?”相关的问题

更多“有关BP网络的说法,哪个是正确的()?”相关的问题

第1题

A.FasterRCNN主要是采用选择性搜索实现候选框提取

B.FasterRCNN使用SVM进行目标类别分类

C.FasterRCNN使用一个卷积实现分类和位置微调

D.FasterRCNN的损失函数与RCNN相同,位置损失函数采用交叉熵

第2题

A.如果训练样本量较大,可选用随机梯度下降(SGD),它考虑历史梯度信息,更容易跳出局部极小值点

B.在高度非凸的深度网络优化过程,主要难点是鞍点

C.用无监督数据作分层预训练(Layer-wisePre-train)有助于解决梯度饱和问题

D.Sigmoid交叉熵损失函数适合于多标签学习,每一维彼此独立

第3题

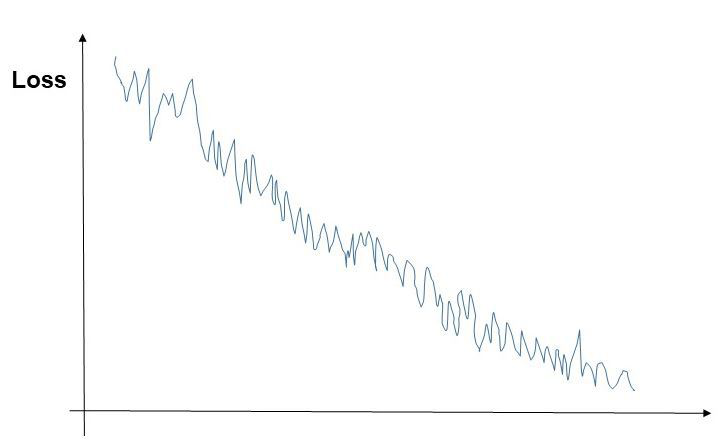

如果你训练的模型代价函数J随着迭代次数的增加,绘制出来的图如下,那么()。

A.无论你在使用mini-batch还是批量梯度下降,看上去都是合理的

B.如果你正在使用mini-batch梯度下降,那可能有问题;而如果你在使用批量梯度下降,那是合理的

C.如果你正在使用mini-batch梯度下降,那看上去是合理的;而如果你在使用批量梯度下降,那可能有问题

D.无论你在使用mini-batch还是批量梯度下降,都可能有问题

第4题

A.对激活函数的输出结果进行范围限定,有助于梯度平稳下降,而ReLU输出范围无限的函数会导致梯度消失问题

B.ReLU函数中所有负值均被截断为结果0,从而导致特征丢失,可适当调高学习率避免此类情况

C.RMSProp学习率调整策略引入累积梯度的概念,从而解决学习率过早趋向于0而结束训练

D.随机梯度下降(SGD)每次更新只随机取一个样本,按照固定学习率计算梯度,所以速度较快

第5题

A.BP神经网络的训练过程中,先进行后向传播再进行前向传播

B.通过损失函数对后向传播结果进行判定

C.通过前向传播过程对权重参数进行修正

D.训练过程中权值参数的运算量很大,一般采用梯度下降法

第7题

A.ReLU函数的输出是非零中心化的,给后一层的神经网络引入偏置偏移,会影响梯度下降的效率

B.ReLU神经元在训练时比较容易“死亡”.在训练时,如果参数在一次不恰当的更新后,第一个隐藏层中的某个ReLU神经元在所有的训练数据上都不能被激活,那么这个神经元自身参数的梯度永远都会是0,在以后的训练过程中永远不能被激活.

C.LeakyReLU在输入时,保持一个很小的梯度,这样当神经元非激活时也能有一个非零的梯度可以更新参数,这在一定程度上缓解了梯度消失问题

D.三个选项均正确

第8题

A.梯度方向是函数值下降最快方向

B.梯度下降算法是一种使得损失函数最小化的方法

C.梯度下降算法用来优化深度学习模型的参数

D.梯度反方向是函数值下降最快方向

第10题

A.权重和偏置都可以取全零初始化

B.使用正态分布初始化,但权重取太大或太小都会影响网络的训练

C.Xavier初始化可以减少梯度消失

D.合适的权重初始化可以加快神经网络的训练和效果

为了保护您的账号安全,请在“上学吧”公众号进行验证,点击“官网服务”-“账号验证”后输入验证码“”完成验证,验证成功后方可继续查看答案!

微信搜一搜

微信搜一搜

上学吧

上学吧

微信搜一搜

微信搜一搜

上学吧

上学吧